Greenfield vs. Migration

Operativ geplant statt "irgendwie umziehen"

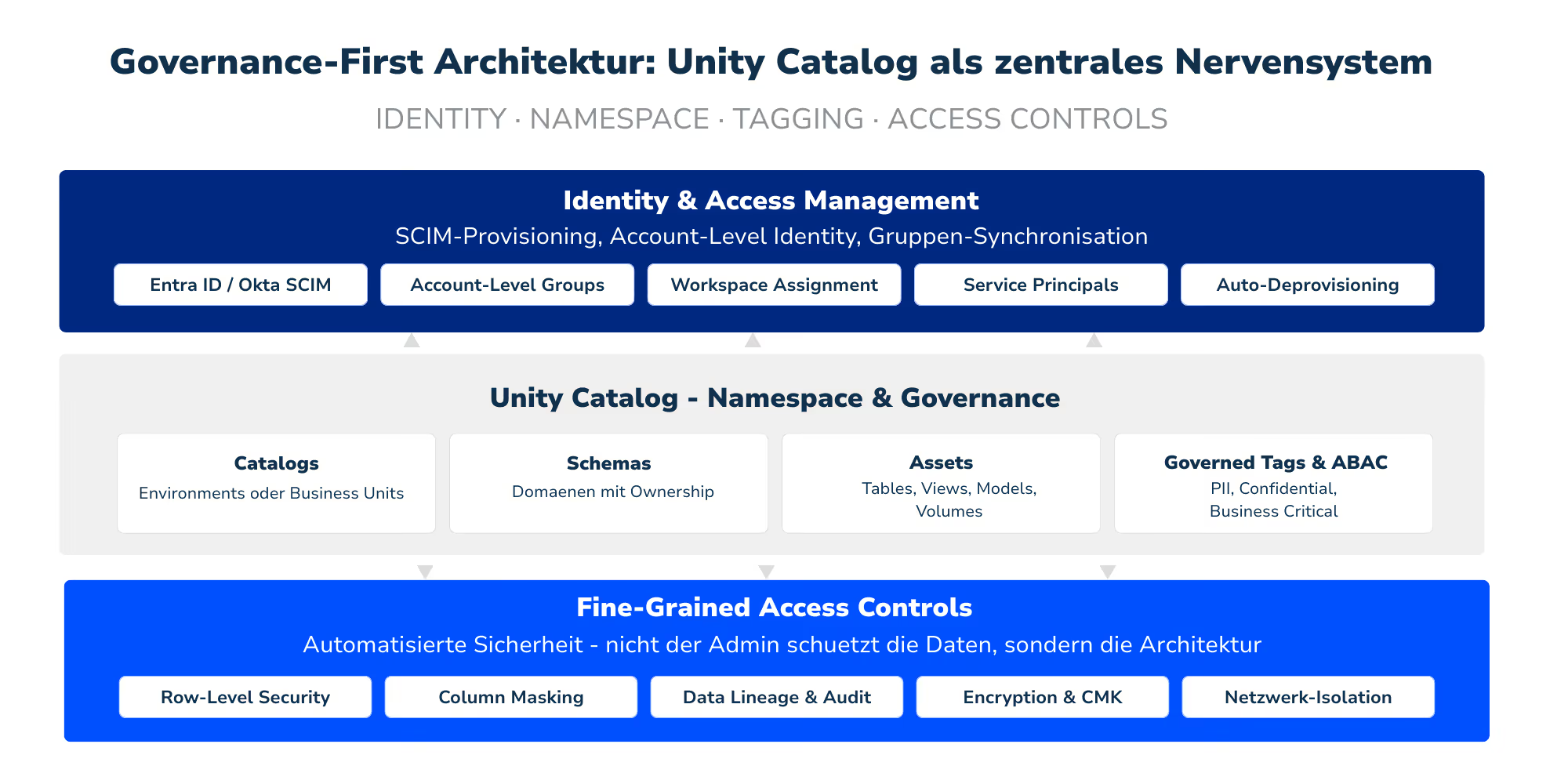

Bei einem Greenfield-Projekt bauen wir die Plattform einmal richtig auf; mit einer Architektur, die von Anfang an für mehrere Teams und Domänen trägt. Das heißt: Governance, Kostenmodell und Namespace-Struktur stehen, bevor der erste Use-Case live geht, damit ihr nicht nach sechs Monaten eine zweite Plattform neben der ersten bauen müsst.

Während eurer Migration folgen wir einem klaren Playbook, um sicherzustellen, dass der Umzug kein Big-Bang-Risiko wird. Wir beginnen mit der Discovery-Phase, um Datenobjekte, Workflows, Abhängigkeiten und Konsumenten umfassend zu verstehen; der Ablauf folgt einer bewährten Sequenz: Wir entwickeln die neue Plattform also parallel und richten das Dual-Running dort ein, wo es aus fachlicher Sicht Sinn macht. Der Cutover erfolgt in klaren Wellen und die Altumgebung wird kontrolliert dekommissioniert, nachdem alles erfolgreich validiert wurde.

Um Migration nicht zur Dauerbaustelle werden zu lassen, gliedern wir sie in typische Workstreams. Unser Plan ist es, Identity und Permissions so zu gestalten, dass Gruppen, Rollen und Ownership ordentlich in den Unity Catalog integriert werden und nicht als Einzelfall-Ausnahmen enden. Unser Ansatz für Data Movement ist, dass historische Daten, inkrementelle Updates und CDC konsistent zusammengeführt werden. Wir führen die Migration von Workflows so durch, dass alles, was Scheduling, Parameterisierung, Secrets und Monitoring betrifft, vollständig mitwandert. Wir klären BI und den Semantic Layer frühzeitig, da Reporting Parity in vielen Organisationen das Hauptabnahmekriterium ist. Und wir integrieren eine robuste Validierung, um sicherzustellen, dass Cutovers nicht nach Gefühl festgelegt werden.

Der Cutover findet erst statt, wenn die Kriterien klar erfüllt sind. Wir nutzen einen sauberen Datenabgleich, der neben den Volumenprüfungen auch fachliche Kontrollsummen und kritische Metriken umfasst. Wir sorgen dafür, dass Reports und Dashboards die vereinbarten Kennzahlen konsistent liefern und dass ein Rollback-Plan praktisch umsetzbar ist, falls ein Cutover-Fenster nicht erfolgreich ist. Die Altumgebung wird erst dann dekommissioniert und der Betrieb sowie die Ownership gehen vollständig auf die neue Plattform über, wenn diese Punkte erfüllt sind.

Details zu Migrationspfaden (Snowflake, Hadoop, SAP, Azure Synapse): Databricks Migration

Unverbindliches Gespräch

.avif)

.avif)