Data Lakehouse: Architektur, Vorteile und Implementierung 2026

Data Lakehouse vereint Data Lake und Data Warehouse. ACID-Transaktionen, AI-Ready-Architekturen und Open Table Formats richtig einsetzen; mit Praxisbezug.

Data Lakehouse vereint Data Lake und Data Warehouse. ACID-Transaktionen, AI-Ready-Architekturen und Open Table Formats richtig einsetzen; mit Praxisbezug.

Wenn euer Data Warehouse zu teuer wird und euer Data Lake im Chaos versinkt, ist das selten ein Tool-Problem. Es ist ein Architekturproblem. Die klassische Zwei-Tier-Architektur mit Data Lake für günstige Speicherung und Data Warehouse für performante Analysen war nie eine echte Lösung, sondern ein Workaround: Zwei Systeme, weil keines allein alle Anforderungen erfüllen konnte. Das Ergebnis kennt jeder, der länger als zwei Jahre mit Datenplattformen arbeitet: doppelte Infrastruktur, endlose ETL-Pipelines, Daten, die zwischen Systemen kopiert werden, und Governance-Chaos, sobald das Volumen wächst.

Bereits 75 % aller Unternehmensdaten entstehen direkt an Maschinen, Sensoren und Endgeräten statt im zentralen Rechenzentrum (Gartner). Gleichzeitig steigen die globalen Ausgaben für Big Data und Analytics auf 420 Milliarden Dollar. Wer in diesem Umfeld eine AI-Ready-Architektur aufbauen will, kommt am Data Lakehouse als Fundament nicht vorbei.

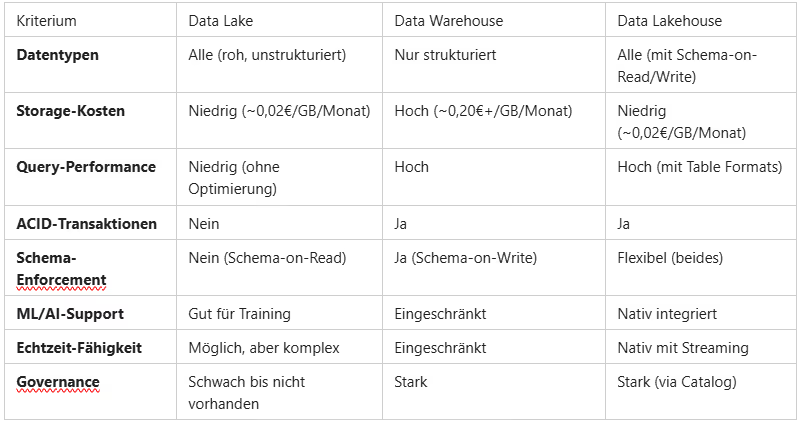

In diesem Guide erfährst du, was ein Data Lakehouse technisch ausmacht, wie es sich von Data Lake und Data Warehouse unterscheidet, welche Open Table Formats dominieren und warum die Architektur entscheidend ist für Agentic AI.

Ein Data Lakehouse ist eine Datenarchitektur, die die Flexibilität und Kosteneffizienz eines Data Lake mit der Struktur, Performance und Governance eines Data Warehouse vereint. Es speichert alle Datentypen (strukturiert, semi-strukturiert und unstrukturiert) auf günstigem Object Storage und ermöglicht gleichzeitig ACID-Transaktionen, Schema-Enforcement und performante SQL-Abfragen.

Was das Lakehouse von bisherigen Architekturen unterscheidet, ist ein Paradigmenwechsel: Daten werden nicht mehr zwischen Systemen kopiert. Statt ETL-Pipelines, die Daten vom Lake ins Warehouse schieben, arbeiten BI-Tools, Data-Science-Workloads und Streaming-Anwendungen direkt auf derselben Datenbasis.

Ohne Schema-Enforcement, Transaktionssicherheit und zentrale Governance verwandeln sich Data Lakes in unstrukturierte Datenfriedhöfe. Daten werden ohne Dokumentation gespeichert, Duplikate entstehen, und niemand weiß mehr, welche Version einer Tabelle die aktuelle ist.

Das Ergebnis: Data Scientists verbringen 80% ihrer Zeit mit Data Wrangling statt mit Analyse. Verbringt dein Data-Team mehr Zeit mit Datenbeschaffung als mit Modellierung? Dann liegt das an der Architektur.

Klassische Warehouses koppeln Storage und Compute. Wächst das Datenvolumen, wachsen die Kosten mit; oft schneller als der Business Value.

Dazu kommt die Rigidität: Schema-Änderungen sind aufwendig, neue Datenquellen erfordern komplexe ETL-Entwicklung, und unstrukturierte Daten wie Bilder, Audio oder Logs passen schlicht nicht ins relationale Modell.

Jede Datenkopie zwischen Systemen ist eine potenzielle Fehlerquelle. Batch-ETL-Jobs laufen nachts, wodurch Analysen auf Daten von gestern basieren. Für Echtzeit-Use-Cases wie Fraud Detection, dynamische Preisgestaltung oder Real-Time Analytics ist das inakzeptabel.

Heißt: Wer ETL zwischen Lake und Warehouse betreibt, akzeptiert strukturelle Latenz als Feature, nicht als Bug.

Die Entscheidung zwischen den Architekturen hängt von euren Use Cases, eurem Datenvolumen und euren Governance-Anforderungen ab. Hier ein direkter Vergleich, der die Unterschiede technisch und nicht nur marketingseitig darstellt:

...wenn dein primärer Use Case klassisches BI-Reporting ist, deine Daten bereits strukturiert vorliegen und du ein stabiles, vorhersagbares Datenmodell hast. Für reine SQL-Workloads mit moderatem Datenvolumen und ohne ML-Anforderungen bleibt das Warehouse eine valide Option. Aber sei ehrlich: Wie viele Unternehmen haben heute noch „nur SQL-Workloads"?

...wenn du heterogene Datenquellen hast (SAP, IoT, Logs, Bilder), Machine Learning und BI auf derselben Plattform betreiben willst, Echtzeit-Anforderungen hast oder zukünftig Agentic AI nutzen möchtest. Das Lakehouse lohnt sich, sobald eure Datenplattform mehr leisten soll als reines Reporting.

...wenn du primär Rohdaten für spätere, noch unbekannte Analysen archivieren willst und keine sofortigen Governance-Anforderungen hast. In der Praxis ist das selten der Fall. Die meisten „reinen" Data Lakes werden früher oder später zum Lakehouse migriert, weil die fehlende Governance zum Showstopper wird.

Die Basis bildet Object Storage wie Amazon S3, Azure Data Lake Storage (ADLS) oder Google Cloud Storage. Hier liegen die Daten in offenen Formaten wie Parquet oder ORC. Der Vorteil: extrem niedrige Kosten (oft unter 0,02€ pro GB/Monat) und nahezu unbegrenzte Skalierbarkeit. Der Fehler, den viele machen: Sie behandeln Object Storage wie ein Filesystem und wundern sich über Performance-Probleme bei Small Files.

Open Table Formats wie Delta Lake, Apache Iceberg oder Apache Hudi fügen dem Object Storage ACID-Transaktionen, Schema-Evolution und Time Travel hinzu. Diese Schicht macht aus dem „dummen" Object Storage ein transaktionales Datensystem. Ohne Table Format ist euer Lakehouse nur ein Marketing-Begriff.

Query Engines wie Apache Spark, Trino, Flink oder Presto verarbeiten die Daten. Da Storage und Compute entkoppelt sind, könnt ihr Rechenleistung unabhängig vom Datenvolumen skalieren und nur bezahlen, was ihr tatsächlich nutzt. Das klingt trivial, aber es ist der fundamentale Unterschied zu klassischen Warehouses, wo ihr für Compute bezahlt, auch wenn niemand Queries ausführt.

Unity Catalog, Apache Polaris oder Project Nessie liefern zentrale Metadatenverwaltung, Zugriffssteuerung und Data Lineage. Diese Schicht sorgt dafür, dass das Lakehouse nicht zum nächsten Data Swamp wird. Governance ist kein Nice-to-have, sondern der Grund, warum das Lakehouse funktioniert, wo der Data Lake gescheitert ist.

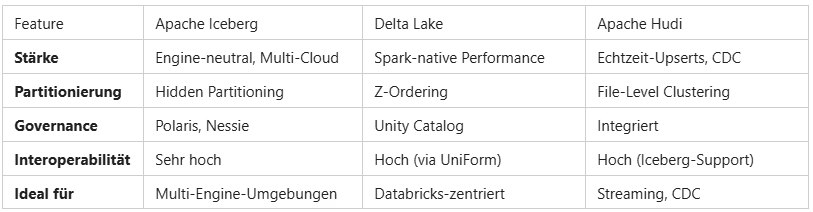

Die Wahl des Table Formats war lange eine strategische Entscheidung mit Lock-in-Risiko. Inzwischen hat sich das Bild gewandelt: Die Formate konvergieren, und Interoperabilität wird zum Standard. Trotzdem gibt es Unterschiede, die für eure Architekturentscheidung relevant sind.

Für einen tieferen Vergleich siehe unsere Table Formats Übersicht.

Die Medallion Architecture ist das bewährte Pattern für Datenqualität im Lakehouse. Die drei Schichten existieren aus einem Grund: Fehler isolieren und Debugging ermöglichen.

Heißt: Jede Schicht hat klare Ownership und SLAs. Fehler in der Verarbeitung können isoliert werden, ohne die gesamte Pipeline zu invalidieren. Ohne Medallion Architecture habt ihr eine Pipeline, aber kein debugbares System.

.avif)

Vorteile

Das Lakehouse eliminiert die Notwendigkeit, Daten für verschiedene Workloads zu kopieren. Data Engineers, Data Scientists und Business Analysts arbeiten auf derselben Datenbasis. Das reduziert nicht nur Infrastrukturkosten, sondern auch Konsistenzprobleme und Governance-Overhead. Konkret: Keine Diskussionen mehr darüber, welche Zahl stimmt: die im Warehouse oder die im Lake.

Keine nächtlichen ETL-Jobs, die scheitern, weil sich das Quellschema geändert hat. Keine Data Scientists, die ihre eigenen Daten-Exports bauen, weil das offizielle Warehouse ihre Features nicht hat.

Während klassische Warehouses Storage und Compute bündeln, könnt ihr im Lakehouse beides unabhängig skalieren. Daten auf Object Storage kosten einen Bruchteil von Warehouse-Speicher. Compute-Ressourcen werden nur bei Bedarf provisioniert, idealerweise serverless.

Ein Beispiel: Ein Kunde im E-Commerce-Bereich reduzierte seine Storage-Kosten um 78%, indem er von einem klassischen Warehouse auf ein Lakehouse migrierte. Und das bei identischer Datenmenge. Die Compute-Kosten stiegen initial, weil mehr Nutzer auf die Plattform kamen, aber die Kosten pro Query sanken um 40%.

Open Table Formats bringen Transaktionssicherheit auf Object Storage. Concurrent Writes, Rollbacks und Time Travel sind native Features.

Heißt: Keine korrupten Tabellen mehr durch abgebrochene Jobs, keine inkonsistenten Reads während Writes, und die Möglichkeit, auf jeden beliebigen Datenzustand der Vergangenheit zuzugreifen.

Time Travel wird oft unterschätzt. Wenn ein Analyst fragt „Was war der Wert am 15. letzten Monats?", ist das eine Query, keine Archäologie.

Open Table Formats bringen Transaktionssicherheit auf Object Storage. Concurrent Writes, Rollbacks und Time Travel sind native Features.

Heißt: Keine korrupten Tabellen mehr durch abgebrochene Jobs, keine inkonsistenten Reads während Writes, und die Möglichkeit, auf jeden beliebigen Datenzustand der Vergangenheit zuzugreifen.

Time Travel wird oft unterschätzt. Wenn ein Analyst fragt „Was war der Wert am 15. letzten Monats?", ist das eine Query, keine Archäologie.

Das Lakehouse ist die natürliche Heimat für Machine-Learning-Workloads. Feature Stores, Model Training und Inference laufen auf derselben Plattform wie Analytics. Unstrukturierte Daten (Bilder, Audio, Video) werden nativ unterstützt, was für moderne AI-Anwendungen mit Mosaic AI entscheidend ist.

Für MLOps zahlt sich das direkt aus: Kein separates Feature-Store-System, das mit dem Warehouse synchronisiert werden muss. Keine Daten-Exports für Model Training. Feature Engineering und Model Serving auf derselben Plattform.

Die Total Cost of Ownership eines Lakehouse setzt sich anders zusammen als bei klassischen Architekturen. Die Hauptkostentreiber:

Unternehmen mit starker Datenintegration erreichen einen durchschnittlichen ROI von 10,3x, verglichen mit nur 3,7x bei fragmentierten Systemen (Integrate.io). Das Lakehouse als Unified Platform ist ein direkter Hebel für bessere Integration.

Das Model Context Protocol (MCP) etabliert sich als universeller Standard für die Verbindung von AI Agents mit Unternehmensdaten. Wie USB-C verschiedene Geräte mit einem Kabel verbindet, erlaubt MCP verschiedenen AI-Modellen den sicheren Zugriff auf Lakehouse-Daten.

Bis 2028 werden mehr als 50% der Enterprise-GenAI-Modelle domain-spezifisch sein (Gartner). Diese Domain-Specific Language Models (DSLMs) benötigen kontextreiche, qualitätsgesicherte Daten. Genau das liefert ein gut governiertes Lakehouse.

Für Enterprise RAG und Vector Search ist das Lakehouse die natürliche Datenquelle, nicht ein separates Vector-Store-Silo.

Ein kritischer Trend ist „Headless Data Quality": Datenvalidierung wird nicht mehr in separaten UI-Tools durchgeführt, sondern als unsichtbarer, autonomer Service, der Zuverlässigkeitssignale über MCP bereitstellt. Wenn ein AI Agent das Lakehouse abfragt, erhält er automatisch Informationen darüber, welche Records verifiziert sind und welche aufgrund von Qualitätsproblemen ausgeschlossen werden sollten.

Das ist ein fundamentaler Shift: Data Quality wird von einem manuellen Audit-Prozess zu einem maschinenlesbaren Feature der Daten selbst.

Eine der bedeutendsten Entwicklungen ist Databricks Lakebase: die Integration von transaktionalen Workloads direkt ins Lakehouse. Das Konzept dahinter heißt HTAP (Hybrid Transactional/Analytical Processing): Die traditionelle Trennung zwischen operativen Datenbanken (OLTP) und analytischen Systemen (OLAP) wird aufgehoben. Statt zwei isolierte Systeme zu betreiben und Daten dazwischen zu synchronisieren, verarbeitet eine HTAP-Architektur beide Workload-Typen auf derselben Datenbasis.

Was bedeutet das praktisch? Keine ETL-Pipelines mehr zwischen Operational Database und Analytics. Read-Only Queries auf Live-Daten ohne Impact auf das produktive System. Echtzeit-Analytics auf operativen Daten statt auf Kopien von gestern.

Konsequenz: Change Data Capture (CDC) wird zur Pflicht im Data Engineering. Nightly Batch Loads sind ein Antipattern. Unternehmen setzen auf Kafka-basiertes Streaming und Event-Driven Architectures für Echtzeit-Datensynchronisation.

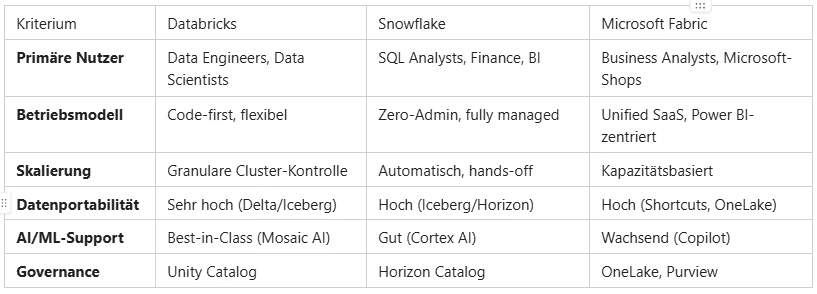

Databricks, Snowflake und Microsoft Fabric bieten alle Lakehouse-Fähigkeiten. Worin sie sich unterscheiden: Herkunft, Architekturphilosophie und Stärken bei spezifischen Workloads.

Databricks kommt aus dem Apache-Spark-Ökosystem und spielt seine Stärken bei komplexen Engineering-Workloads, Machine Learning und heterogenen Daten aus. Entwicklung in Python, Scala und R, Multi-Cloud-Governance über Unity Catalog. Wenn euer Data Engineering Team Code schreibt statt SQL zu klicken, seid ihr hier richtig.

Snowflake bleibt die Referenz für SQL-zentrierte Workloads mit minimalem Administrationsaufwand. Die Multi-Cluster Shared Data Architecture hält die Performance auch bei hoher Concurrency stabil. Stark bei reinen BI-Workloads mit vielen gleichzeitigen Nutzern, wird aber teuer, sobald das Datenvolumen wächst.

Microsoft Fabric setzt auf schnelle Bereitstellung und nahtlose Integration in den Microsoft-Stack. Direct Lake Mode in Power BI ermöglicht Echtzeit-Queries auf Lakehouse-Daten ohne Import. Für Organisationen mit starker Power-BI-Nutzung der naheliegende Einstieg, aber weniger flexibel außerhalb des Microsoft-Ökosystems.

Die Lakehouse-Architektur löst viele Probleme und erzeugt neue.

Die Migration von Legacy-Warehouses ins Lakehouse ist selten ein „Lift and Shift". Schema-Mappings, ETL-Logik, Governance-Strukturen; alles muss neu gedacht werden. Wer das gesamte Warehouse auf einen Schlag migrieren will, hat nach zwölf Monaten ein aufgebrauchtes Budget und Legacy-Systeme, die immer noch laufen.

Besser: Neue Use Cases direkt im Lakehouse starten, Legacy-Workloads inkrementell nach Business Value migrieren.

SQL bleibt im Lakehouse eine tragende Säule; Spark SQL, Databricks SQL und dbt machen SQL-zentrische Architekturen absolut möglich. Neu sind die Konzepte drumherum: Cloud-Infrastruktur, Table Formats, Medallion-Architektur, Governance. Diese Lernkurve ist real und verschwindet nicht durch Tool-Einkauf.

Wer das vermeiden will, investiert in Enablement statt in Dauermandate für externe Berater. Interne Champions, die Wissen multiplizieren, bringen langfristig mehr.

Serverless und Auto-Scaling klingen gut, bis die erste Rechnung kommt. Ohne Cluster Policies, Auto-Termination und klare Regeln für Job- vs. All-Purpose-Cluster explodieren die Kosten. FinOps-Guardrails gehören von Anfang an in die Architektur, nicht als Nachgedanke.

Das Lakehouse macht es leicht, Daten zu speichern. Zu leicht. Alles landet in Bronze, niemand definiert Quality Checks für Silver, und Gold-Tabellen basieren auf unvalidierten Upstream-Daten. Ohne Data Contracts, Quality Checks in der Pipeline und klare Ownership pro Tabelle entsteht der nächste Data Swamp; nur diesmal mit ACID-Transaktionen.

AI-ROI braucht im Schnitt zwei bis vier Jahre; nur 6 % schaffen es innerhalb eines Jahres (Deloitte). Der Unterschied liegt selten in der Technologie. Kultureller Wandel, Prozess-Redesign und die Qualität der Datenintegration entscheiden. Gut integrierte Architekturen liefern 10,3x ROI, schlecht integrierte nur 3,7x (Integrate.io). Das Lakehouse schafft die technische Basis dafür; die organisatorische Arbeit bleibt.

Das Data Lakehouse ist das Standardmuster für moderne Datenarchitekturen. Eine Plattform für alle Workloads, offene Formate statt Vendor Lock-in, und die technische Basis für Agentic AI. Aber Technologie allein reicht nicht; Integration, Enablement und Change Management entscheiden über den Erfolg.

Wo ihr anfangen könnt:

Ein Data Lakehouse ist eine Datenarchitektur, die die Kosteneffizienz und Flexibilität eines Data Lake mit der Performance und Governance eines Data Warehouse kombiniert. Es nutzt Open Table Formats wie Delta Lake oder Apache Iceberg, um ACID-Transaktionen und Schema-Enforcement auf günstigem Object Storage zu ermöglichen. Alle Datentypen (strukturiert, semi-strukturiert, unstrukturiert) werden auf einer Plattform vereint.

Ein Data Warehouse speichert strukturierte, aufbereitete Daten in einem festen Schema und ist optimiert für SQL-Queries und BI. Ein Data Lake speichert Rohdaten in beliebigen Formaten ohne festes Schema und ist optimiert für flexible Exploration und ML. Das Lakehouse kombiniert beide Ansätze: die Flexibilität des Lake mit der Governance des Warehouse.

Nein. Databricks ist eine Unified Analytics Platform, die auf dem Lakehouse-Paradigma basiert. Sie nutzt Delta Lake als Table Format und ermöglicht sowohl Data-Lake- als auch Data-Warehouse-Workloads auf derselben Plattform. Databricks speichert keine Daten selbst, sondern setzt als Compute- und Governance-Plattform auf eurem Object Storage (S3, ADLS, GCS) auf.

Azure Data Factory (oder vergleichbare ETL-Tools) ist ein Orchestrierungsservice für Datenpipelines, also ein Tool zum Bewegen und Transformieren von Daten. Ein Data Lakehouse ist eine Speicher- und Analyse-Architektur. Data Factory kann genutzt werden, um Daten in ein Lakehouse zu laden. Beide sind komplementär, nicht konkurrierend.

Azure Data Factory (oder vergleichbare ETL-Tools) ist ein Orchestrierungsservice für Datenpipelines, alsDie Kosten variieren stark je nach Datenvolumen, Workload-Profil und Plattformwahl. Storage auf Object Storage kostet typisch 0,02-0,03€/GB/Monat, also 70-90% günstiger als Warehouse-Storage. Compute wird nach Nutzung abgerechnet (DBUs, Credits, CUs).o ein Tool zum Bewegen und Transformieren von Daten. Ein Data Lakehouse ist eine Speicher- und Analyse-Architektur. Data Factory kann genutzt werden, um Daten in ein Lakehouse zu laden. Beide sind komplementär, nicht konkurrierend.

Apache Iceberg für Multi-Engine-Umgebungen und maximale Interoperabilität, besonders wenn ihr nicht sicher seid, ob ihr langfristig bei einer Plattform bleibt. Delta Lake für Databricks-zentrierte Architekturen mit bester Performance. Apache Hudi für Streaming-intensive Workloads mit CDC und hohem Upsert-Volumen. Mittlerweile konvergieren die Formate durch Interoperabilitäts-Features wie UniForm. Die Entscheidung wird dadurch weniger kritisch als noch vor zwei Jahren.

Nutzen Sie die Gelegenheit für ein kostenloses Erstgespräch: Persönlich, direkt und ohne Floskeln. Wir sprechen über Ihre Herausforderungen und erste konkrete Lösungsansätze.