Vorbereitung

Wir wählen gemeinsam einen Use-Case mit echter Relevanz, klären Stakeholder, Abnahme und Datenzugang (inkl. Datenschutz/Compliance) und definieren die organisatorische Baseline.

Scope & Design

Wir formulieren eine messbare Hypothese, definieren die Erfolgskriterien vor dem Start und skizzieren eine produktionsnahe Zielarchitektur; genug Struktur für belastbare Ergebnisse, ohne Voll-Implementation.

Build & Integrate

Datenintegration und Use-Case-Implementierung entlang der Hypothese: z. B. SQL-Benchmarking, Pipeline-Migration, SAP-Extraktion, Echtzeit-Streaming, ein Data-Quality-Framework, AI/ML-Use-Cases (RAG, Churn Prediction, Anomaly Detection) oder ein Agentic AI Workflow. Governance realistisch mitgedacht, Security schlank berücksichtigt.

Validate & Measure

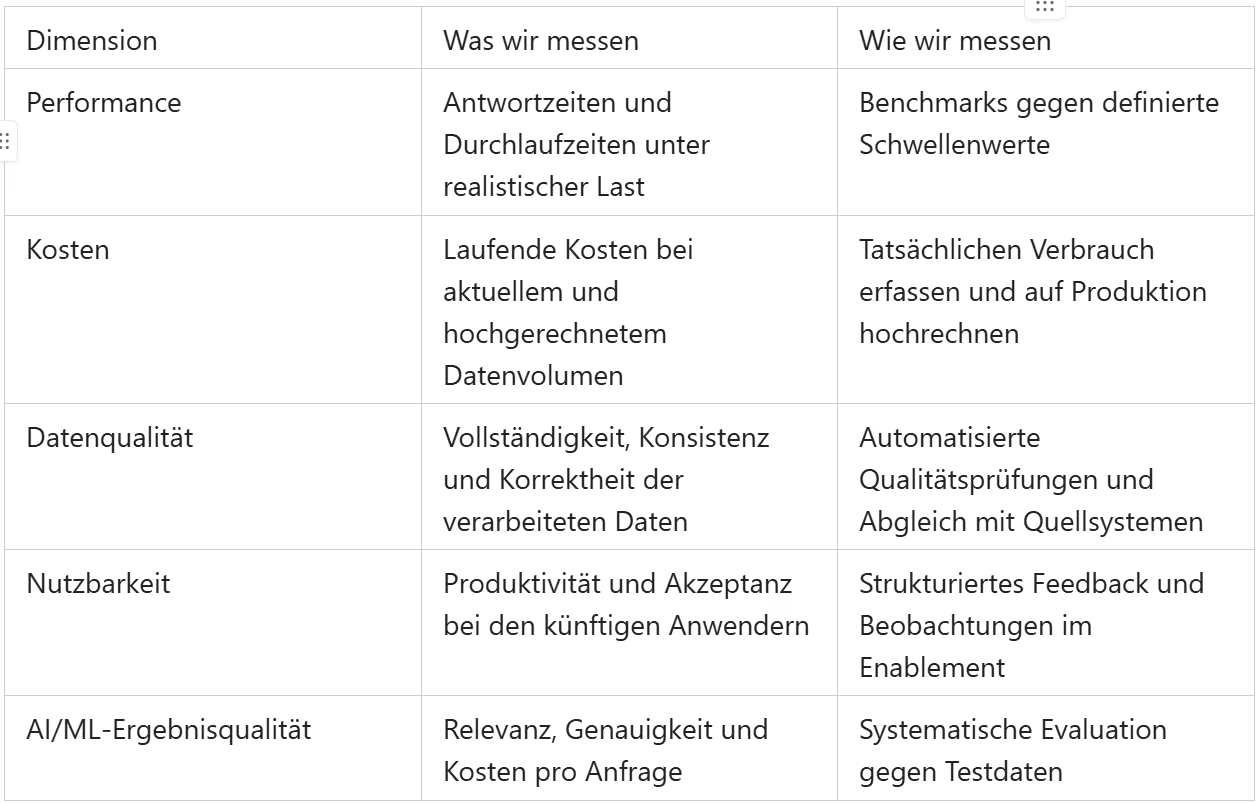

Validierung gegen die vereinbarten Erfolgskriterien; Performance, Kosten, Datenqualität, Korrektheit und Nutzerfeedback. Wir testen sinnvolle Varianten und leiten eine belastbare Kostenprojektion ab.

Empfehlen & Planen

Entscheidungsvorlage mit Handlungsempfehlung und Next Best Actions. Bei positivem Ergebnis: konkrete Roadmap zur Produktion. Bei negativem Ergebnis: saubere Dokumentation, warum; und welche Alternativen sinnvoll wären. Artefakte bleiben wiederverwendbar.

.avif)

.avif)