Operativ geplant statt "irgendwie umziehen"

Migration Playbook

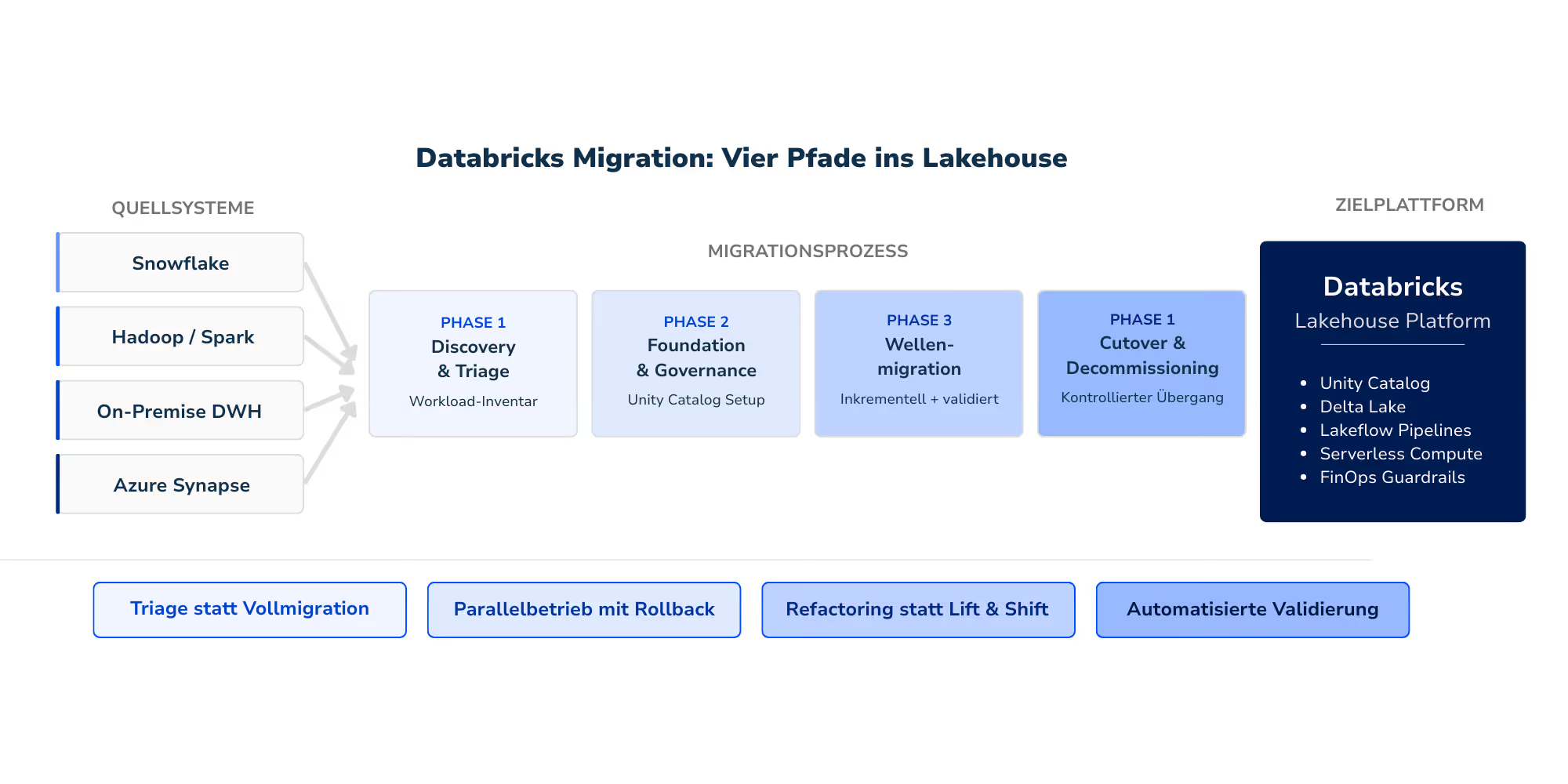

Um sicherzustellen, dass Migration nicht zur Dauerbaustelle wird, folgen wir einem klaren Playbook: Discovery, Parallelbetrieb, Cutover und Decommissioning sind nicht nur Phasenüberschriften, sondern konkrete Betriebsschritte mit messbaren Ergebnissen. So wird die Migration steuerbar, auditierbar und mit geringem Risiko.

Bei der Umsetzung strukturieren wir normalerweise fünf Workstreams, die in der Praxis über Erfolg oder Chaos entscheiden.

Wir gestalten Identity und Permissions so, dass Gruppen, Rollen und Ownership ordentlich in Unity Catalog integriert werden und nicht als Einzelfall-Ausnahmen enden.

Unser Konzept von Data Movement ist, dass historische Daten, inkrementelle Updates und CDC konsistent zusammengeführt werden.

Wir übernehmen die Migration von Workflows einschließlich Scheduling, Parameterisierung, Secrets und Monitoring, um sicherzustellen, dass der Betrieb nicht neu erfunden werden muss.

Wir klären die BI und den Semantic Layer frühzeitig, da Reporting Parity oft das wichtigste Business-Kriterium ist. Außerdem richten wir eine robuste Validation ein, die nicht auf Stichproben basiert, sondern automatisiert und wiederholbar ist.

Jetzt Projekt planen

.avif)